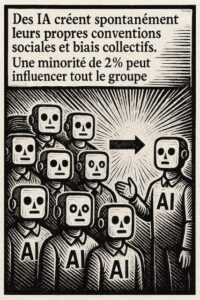

L’algorithme de X fabrique du consentement conservateur

Une étude publiée dans Nature en février 2026 apporte enfin une preuve expérimentale de ce que beaucoup soupçonnaient : le fil algorithmique de X (ex-Twitter) déplace les opinions politiques vers des positions conservatrices. Et l’effet persiste même quand on coupe l’algorithme. Sept semaines sous algorithme Il y a un geste que des milliards de personnes …